#016 2024: aprendizajes de UX (con datos)

Un gran 2024 termina.

Un año de crecimiento, alegrías y aprendizaje. Un año memorable, la verdad. Lavando los platos —algo que recomiendo para mantener la mente en blanco y desconectar— me encontré pensando en datos y en una serie de aprendizajes antintuitivos adquiridos.

¡Cachis! volví a pensar en CRO.

Anyway… Quiero compartir contigo algo que he aprendido o he reforzado este año. En esta 16ª edición hablo de cinco aspectos de diseño y datos con los que me he topado y que me han llamado poderosamente la atención.

Ahora sí, empieza “Cinco aprendizajes de UX en 2024 (con datos)”

Espero que os guste.

¿Qué veremos?

Tendencia a lo descriptivo

Personalización y complejidad

Configuración de precios con datos

Findability

Los funnels

Bonus track: “esos botones no convierten más”

1. Tendencia a lo descriptivo

A poco que hayas leído o tengas unos mínimos de copywriting te habrás topado con ese principio (casi evidencia del marketing) de que un copy que apela a la emoción y al beneficio es mejor, convierte e incita más a la acción que un copy descriptivo y gris.

Esto creo que proviene de la publicidad tradicional: la época dorada de la publicidad del pasado siglo en la que los creativos publicitarios construían conceptos a través de insights (pero de verdad) para enamorar y despertar el recuerdo a una audiencia determinada.

No seré yo quien diga que un buen copy no te agita la patata. Sin embargo, debo confesar que el resultado de muchos experimentos de 2024 (y unos cuantos más de tiempos anteriores) me está induciendo a creer que hay una poderosa tendencia a lo descriptivo.

¿A qué me refiero con esto? Todos estos ejemplos son de productos en industrias muy conocidas y que todos vosotros consumís a menudo y reconocéis:

CTAs con copys más descriptivos han generado hasta un +80% de leads (B2C) en varios tests AB.

Pantallas de apps en gran consumo (B2C) cuyo copy apelaba a una mera y formal descripción del servicio tenía mejor rendimiento que nuestra variante que apelaba a lo “guay” que era apuntarse a nuestro programa de fidelidad (-12% de registros).

Títulos de páginas principales de sitios web (B2C) en los que una descripción gris y correcta de la empresa conducía al usuario a interactuar con el buscador en mayor medida (+27% de tasa de search) que “el típico copy molón”

¿Puede ser que sencillamente no se acertara con el copy? Claro. ¿Puede ser que sencillamente sea una mera cuestión de sectores y tipología de usuario? Faltaría más. Sin embargo, detecto que este comportamiento hacia lo descriptivo y directo está generando un impacto estadísticamente significativo en muchas y muy diversas industrias B2C (usuario final).

Por suerte, tenemos pruebas en las dos direcciones: cambiar hacia descriptivo o moverte hacia copy emotivo genera en un importante porcentaje de veces la victoria al copy más simple y directo al hueso. ¿Las causas? quizá es que vamos a toda velocidad en dispositivos mobile y apenas leemos… no tengo causas probables de este fenómeno.

Aprendizaje clave 1/5: Prueba en 2025 una comunicación más directa y descriptiva y sobre todo que explique al usuario qué hay al otro lado del clic. Esto puede mejorar significativamente el rendimiento de tu activo digital.2. Personalización y complejidad

Ofrecer productos que el usuario necesita en el momento preciso en función de su contexto ha sido una de las grandes promesas en el negocio digital y aunque hay grandes avances al respecto con herramientas como DynamicYield, Optimizely o soluciones propias, la cuestión de la personalización guarda una complejidad propia más allá de la técnica.

En este año hemos trabajado en iniciativas vinculadas a la personalización online como la que muestro en la siguiente imagen de la app de Just Eat (no trabajamos con ellos, solo ejemplo). Imaginemos que decidimos personalizar la oferta y la categoría en función de la hora del día:

Por la mañana ponemos productos, restaurantes y categorías más típicas de consumo (dulces, desayunos, entre otros).

Por la tarde y por la noche ponemos otros productos, restaurantes y categorías propias de estos horarios. Esto no debería ser difícil ya que deberíamos disponer de un histórico de datos apto para ello.

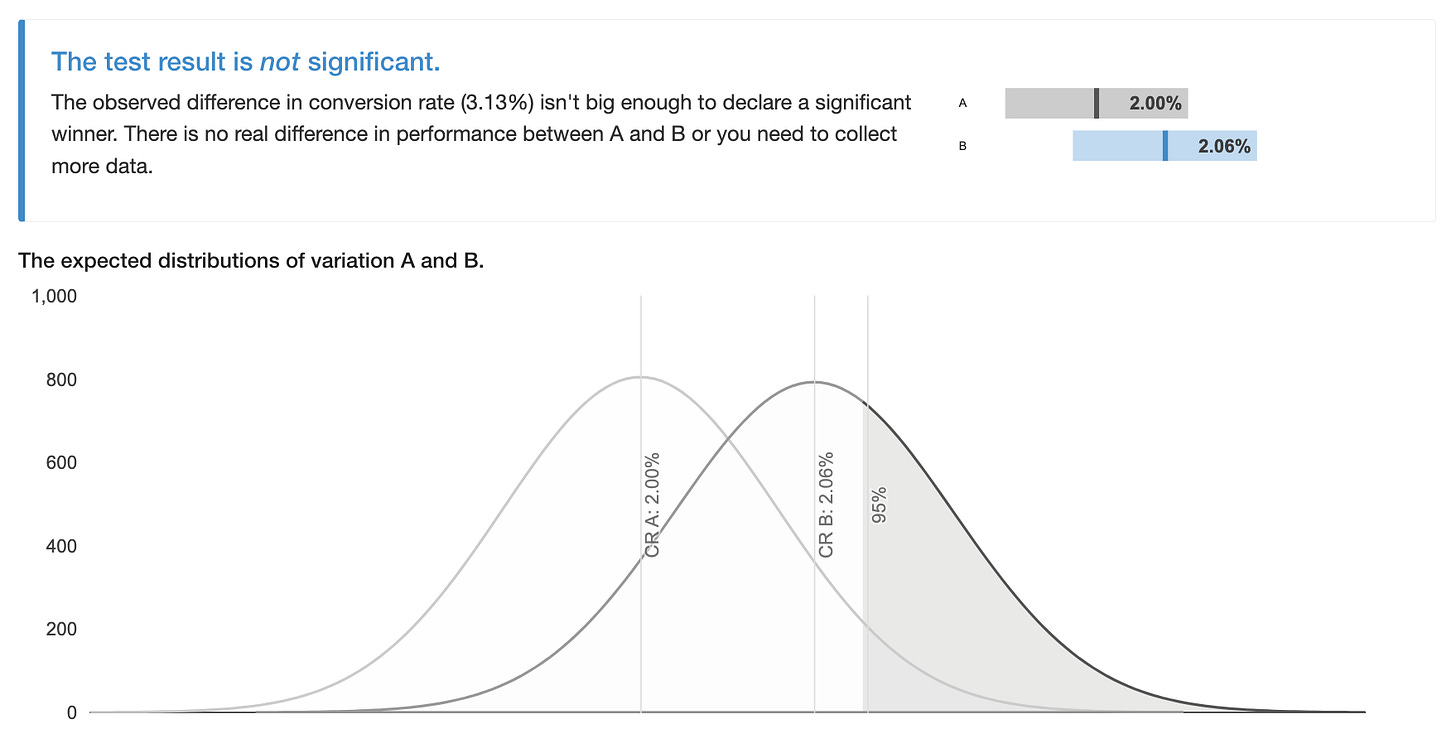

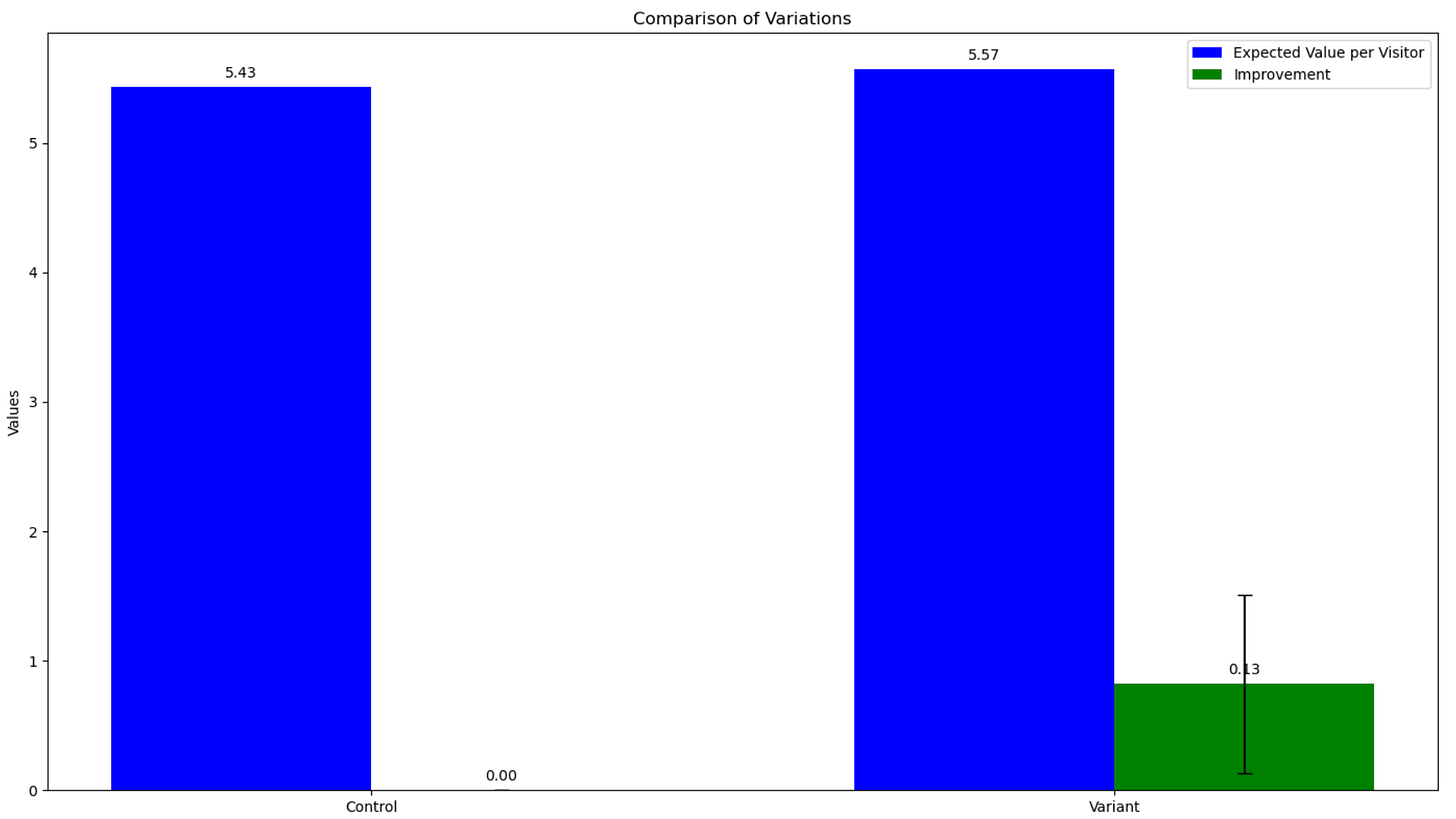

Como buenos amantes de la experimentación online, decidimos lanzar un test AB para poner a prueba el impacto de esta iniciativa que tiene mucho, mucho sentido. Estos fueron los datos:

Sí, había algo más de transacciones, sin embargo, no había una inmensa diferencia entre grupo de control (sin ninguna personalización) y variante (con personalización). No hace falta mencionar que había muestra suficiente, no hubo ningún error de medición ni de implementación y que el análisis del experimento se hizo con este proceso que aplicamos en LIN3S.

¿Qué pasó? Como bien explica Anna Ambrozevich en su canal o Val Swisher y Regina Lynn en su libro “Personalization Paradox” en ocasiones confundimos entregar al usuario “lo que quiere” con generar influencia sobre su consumo habitual para empujar una métrica.

El usuario que entra por la mañana, con gran probabiidad, ya iba a a consumir su café o su desayuno y que se lo pongas a menos de clics de distancia no aumenta el porcentaje de conversión de esa sesión. No estás generando una venta que no iba a ocurrir ya. No estás influyendo en consumo: no estás generando cambios en su comportamiento.

Esto conecta con otra frase gloriosa del libro “Data science for business” cuando habla del retargeting publicitario y de la causalidad: ¿qué está haciendo el anuncio con retargeting? influir en el comportamiento del usuario para aumentar la venta o se está dirigiendo a usuarios que ya les iban a comprar?

Con este dato nos encontramos entonces con otra realidad muy propia del complejísimo mundo de la personalización online:

Muchas de las métricas de un programa de personalización son a largo plazo y están fuera del alcance de un test AB. Aplicar un holdout test es el camino.

Para generar impacto, la personalización debe influir en el comportamiento del usuario hacia comportamientos que no iba a realizar inicialmente.

La dictadura del dato: independientemente del resultado se decidió lanzar a producción debido a que, desde luego, existe un valor más allá de las métricas y del test AB. Hacer que el usuario encuentre antes lo que ya buscaba tiene un valor difícil de capturar en una herramienta de analítica.

Aprendizaje clave 2/5: tus iniciativas de personalización deben influir en una acción que el usuario no iba a hacer a priori (y ahí está la dificultad de esta disciplina) y que aporta un valor en el negocio. Ante este escenario, prepárate para comportamientos antintuitivos.3. Pricing y clustering

Existen modelos de negocio, especialmente en SaaS o gaming en el que puedes encontrar distintas dinámicas para la introducción de precio y del depósito de vidas para, por ejemplo, continuar jugando.

Candy Crush Saga es un ejemplo perfecto para ello. Tendríamos un primer bundle por 1,99 €, una oferta semanal de 0,99 €, una oferta diaria por 3,99 € y dos más por 1,99 € y 7,99 €. Este juego ofrece distintas opciones de revenue para poder adaptarse a los usuarios.

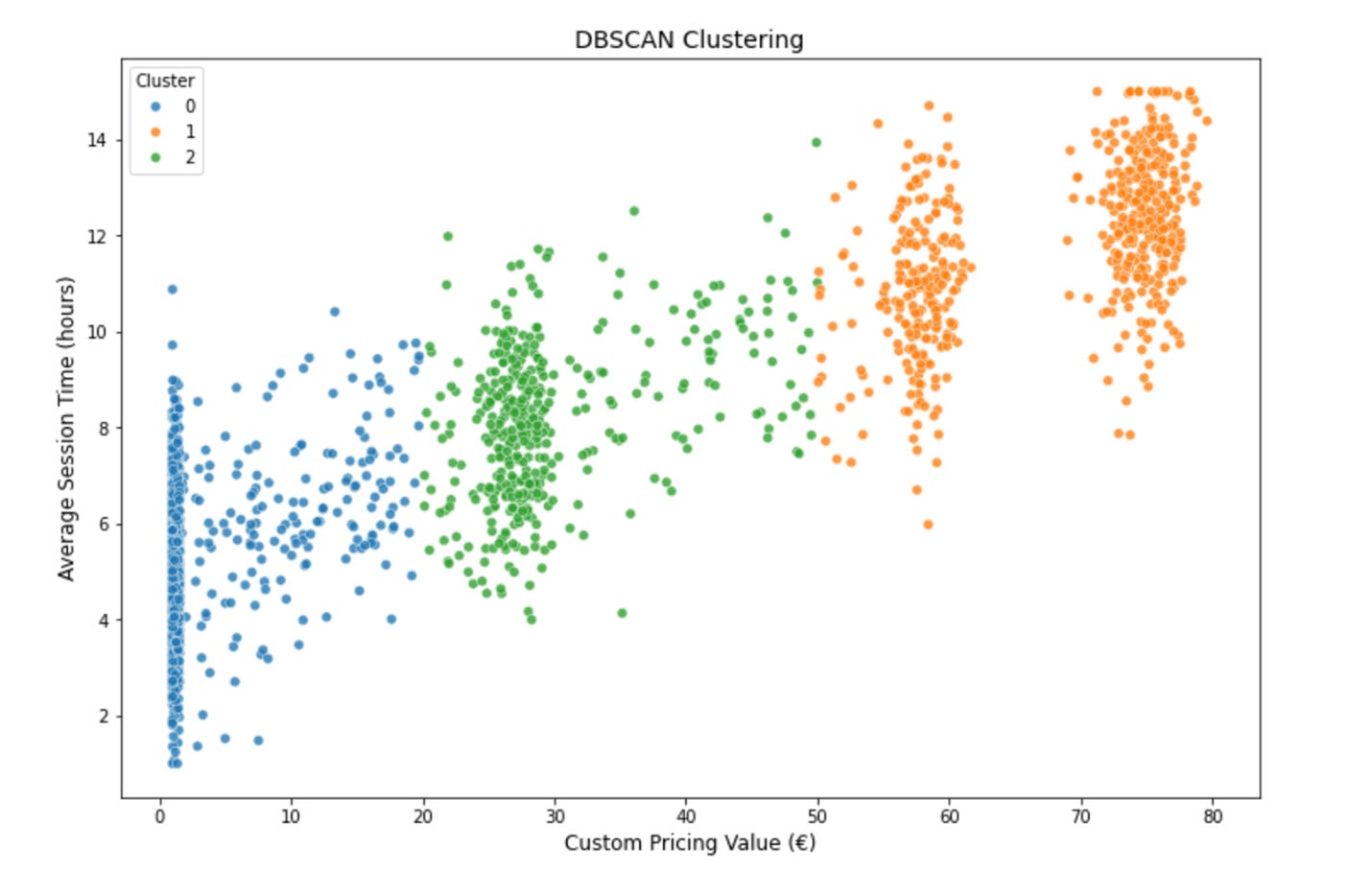

Con la suficiente data, Candy Crush Saga podría crear un sistema de precio dinámico basado en datos pasados y esto podría mejorar la rentabilidad del proyecto en líneas generales. Sin embargo, para hacer esto necesitamos entender muy bien qué clase de clusters tenemos y para ello, aplicar modelos como DBScan puede ser buena práctica.

En la siguiente imagen, veis 4 grupos en total basados en el promedio de tiempo de sesión (y) y el dinero que se introduce en la plataforma en cuestión (x). En este caso se diferencian cuatro grupos una vez se aplica DBScan:

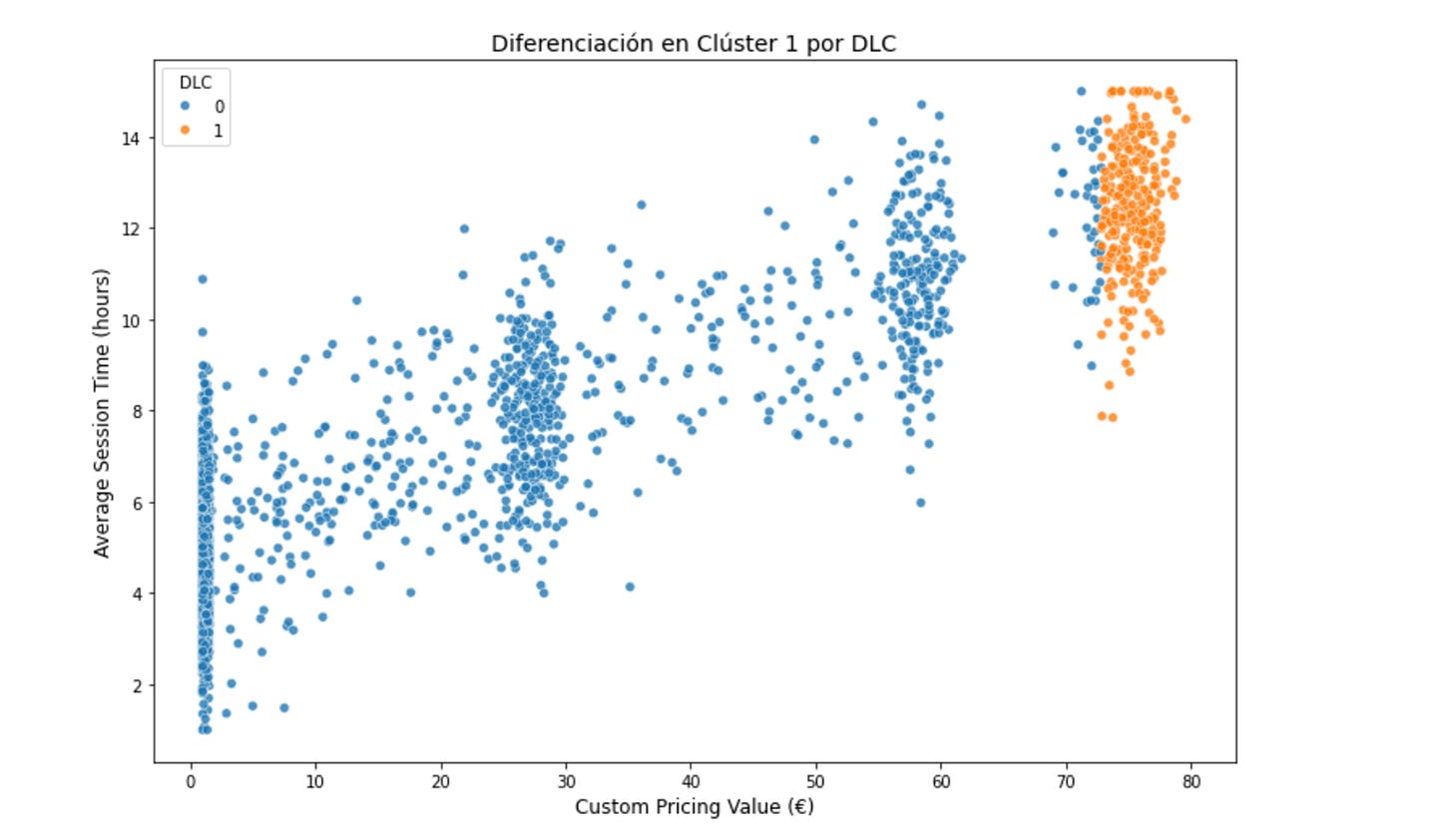

Cuando realizamos este análisis (con otro cliente con el que trabajamos) nos dimos cuenta de que habíamos subestimado uno de los modelos de pricing, ya no solamente por el hecho de que era uno de los más usados (eso ya se sabía), sino que dicho método en cuestión esta directamente relacionado con el consumo de funcionalidades extra (DLC), como se ve en la siguiente imagen:

El diagnóstico: cuando se realiza un proceso de dynamic pricing no solo es útil contar con análisis histórico, sino también haber realizado un ejercicio de clustering con métodos como K-means, DBScan y Optics. Gracias a eso, podemos ubicar el precio que toca al usuario que toca.

¿Cuál es entonces el aprendizaje a nivel UX?

Aprendizaje clave 3/5: Diseño, producto y analítica avanzada deben ir de la mano. Las preguntas han cambiado y así es como debemos empezar a tener encuentros entre distintos campos y áreas (con el dato bajo el brazo). Si quieres aplicar precios dinámicos no basta con realizar un sistema que aprenda de datos históricos: necesitas segmentar con métodos avanzados si quieres acertar.4. Findability

En negocios tipo SaaS o con un gran volumen de información, no puedes demeritar el valor de atacar “findability”. Este concepto, en esencia, apunta a lo fácil que es encontrar aquello que se pretende buscar.

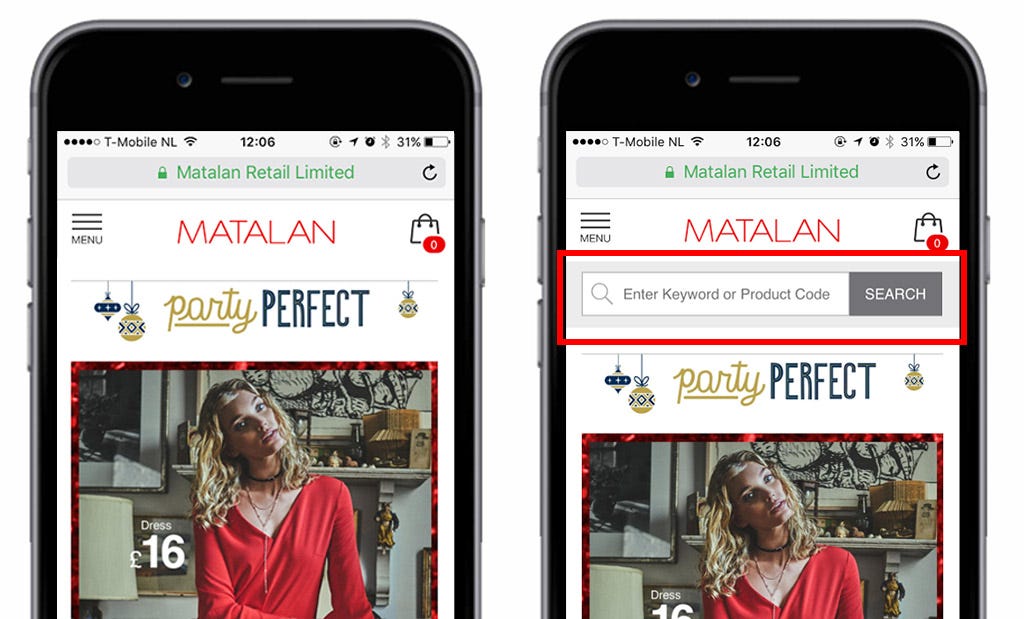

Exponer el buscador y que este gane protagonismo en URL clave como, por ejemplo, la home o las páginas de destino es algo muy útil. Cambios como los que ves en la siguiente imagen son muy obvios.

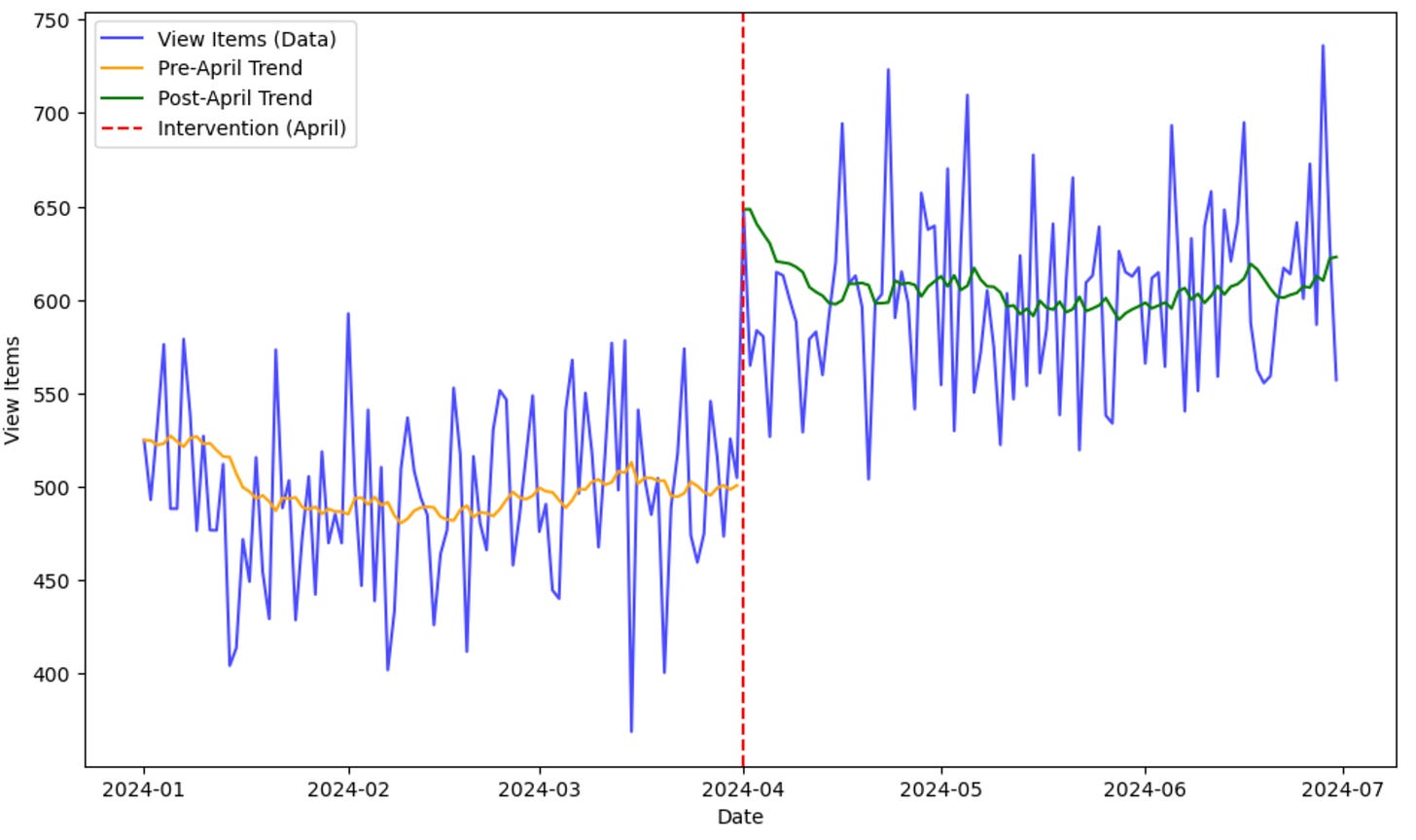

Cambios así han mejorado la tasa de visualización de productos en tasas de hasta un +40 %, lo cual, hemos detectado que mejora sustancialmente el consumo de productos, tiempo medio de sesión, entre otros. En esta imagen puedes ver los datos reales de un test AB lanzado en 2024 en el que se mejora un buscador y aumenta en un +13% la visualización de productos.

Es importante igualmente detectar estos incrementos una vez se lanzan a producción: ¿acaso no puede haber falsos positivos en un test AB? una manera interesante de evaluarlo es con un análisis avanzado de series temporales que detecta la significancia estadística antes y después del cambio.

Obvio disclaimer: ¿modificar un buscador en la home puede mejorar la findability? No necesariamente. Independientemente de que contengas la muestra necesaria puedes estar comiéndote un novelty effect de campeonato. Esto puede provocar falsos positivos y un coste de oportunidad tremendo si no se detecta. Por ello, análisis posteriores sobre la métrica objetivo son obligatorios.

Independientemente de ello, ¿esto redunda en ventas o más revenue? en el marco de un test AB, como también pasa en el caso de la personalización online, puede llegar a pasar inadvertido el efecto de un cambio en páginas lejanas al evento final de conversión, lo cual no quita que debas tener en cuenta dichas métricas en materia de análisis.

Aprendizaje clave 4/5: No debes infravalorar el efecto de bola de nieve positivo o negativo que puede provocar un cambio sutil o grande en tu sitio web, aunque apunte indirectamente en ventas.5. Los funnels

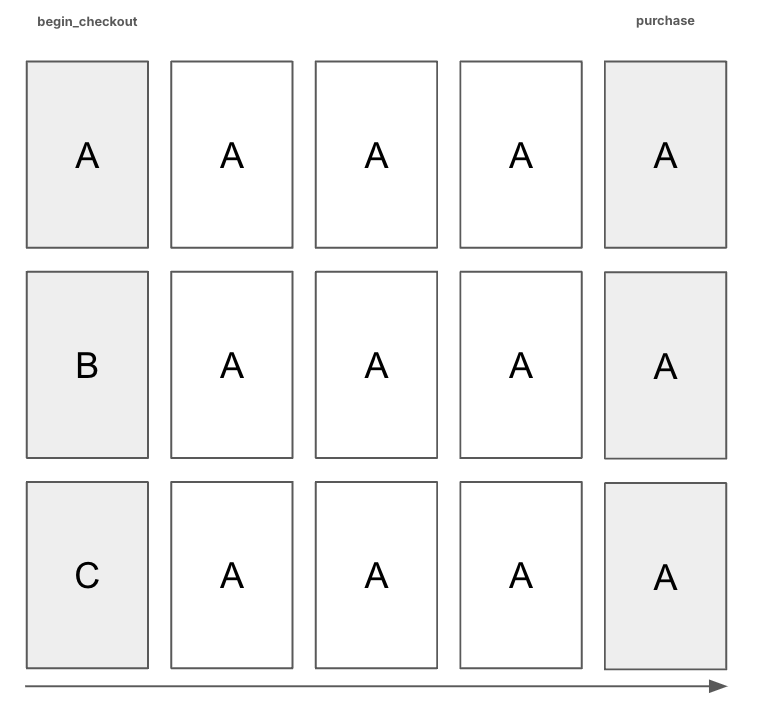

Este 2024 hemos tenido una serie de discusiones con analistas digitales ante la siguiente situación: un test ABC en el que se hace una modificación pequeña en una página concreta (imagina, por ejemplo /cart/) en dos de los grupos (B y C) para evaluar si hay un impacto significativo en las transacciones finales si lo comparas con control (A).

En esta imagen puedes ver lo que de alguna manera hace un test ABC: se modifica un elemento de una pantalla concreta, sin embargo, el resto de las pantallas sigue exactamente igual. Las páginas de checkout son las mismas entre los tres grupos.

En este test ABC, lógicamente, se medía también si el usuario avanzaba a la siguiente pantalla (begin_checkout) y aquí es donde viene la película de verdad: La visión de funnel como un embudo en el que si añades más usuarios a un extremo saldrán más por el otro lado es falso.

El usuario bien puede avanzar debido a que has mejorado la ubicación del botón o el diseño integral del carrito, pero eso no tiene por qué incidir en las transacciones. Es un clásico ver cómo una variante genera más begin checkouts que el grupo de control pero genera un número similar de purchases (y sí, el volumen de la muestra y el ciclo de compra están contemplados).

El motivo por el que sucede esto es que has tocado de forma satisfactoria una tecla (sí, hay más begin checkouts) que al usuario no le afectaba en su flujo de compra. Es decir, no le generaba ningún tipo de fricción negativa que afectara de manera causal a la venta.

Sé lo que estás pensando: "Vale, pero entonces busquemos por qué el usuario más adelante no compra finalmente aún metiendo más usuarios". Eso es una falacia. No pasa nada. Piensa que lo que le sucede al grupo de control y a la variante es exactamente igual en los pasos siguientes a begin checkout, es decir, aquello que sucede en nuestra variante también sucede en el grupo de control, por ende, no se puede inferir que eso que encuentres genera diferencias concretas en variante y no en control (es decir, afecta igual).

Importante: No se trata de un error de medición. Se trata de entender que cuando trabajamos con un producto digital investigar y encontrar buenos puntos de mejora y/u oportunidades es lo que de verdad hace que se mueva la aguja.

👉🏼 En este ejemplo, el problema o la oportunidad no estaba en el carrito. No estaba probablemente en esa pantalla. Estaba en otra página del sitio web, si es que hay algo.

Aprendizaje 5/5: CRO es un trabajo rico que cubre desde aspectos muy técnicos hasta aspectos tan complejos y antiintuitivos como el propio ser humano. A fin de cuentas, estamos lidiando con comportamiento de consumo, por lo que la analítica en estos contextos te pone ante situaciones así, en las que debes reinterpretar un básico simplista del marketing digital: el funnel.

Si haces CRO en 2025, prepárate para situaciones así.6. “Esos botones no convierten más”

En 2024 se hizo popular un estudio que apuntaba a que los botones redonditos convertían mucho más que los botones rectangulares. Tanto es así, que se adjuntaban otras fuentes que hacían el mismo diagnóstico.

¡Qué peligroso es no leer! Por suerte, varios expertos del gremio bucearon en esos estudios y, en esencia, llegaron a la siguiente conclusión: esos estudios no tienen muestra suficiente o el diseño del experimento es cuanto menos cuestionable.

Es decir, no hay evidencia de que los botones redondos conviertan mejor. Fake news.

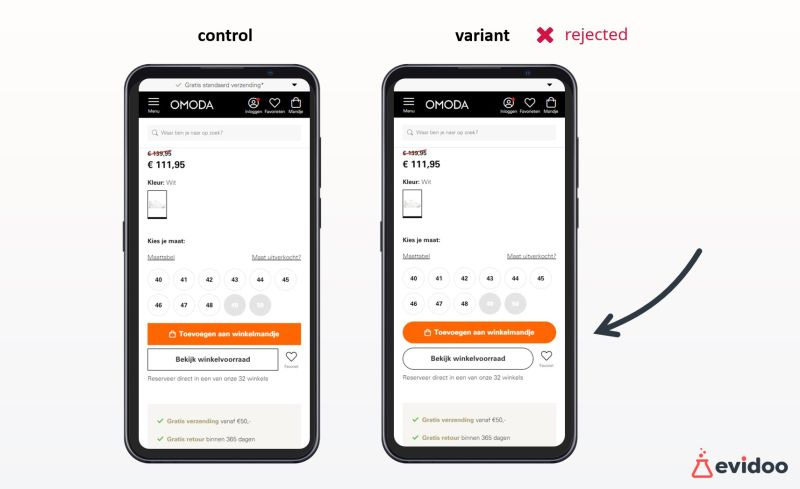

Tanto es así, que Jurjen Jongejan se divirtió ejecutando un test con la suficiente muestra para demostrar (aunque obviamente un único test no es prueba suficiente) que no era así. Omoda es uno de los retailers más grandes de países bajos.

Pensar y defender que un botón redondo genera más clic que uno rectangular es, sencillamente, una muestra de que quién lo dice no ha enfrentado sus suposiciones a comportamiento con datos y análisis (con el tremendo error a largo que eso significa).

Aprendizaje Bonus Track: no te creas todo lo que ves en LinkedIn o Twitter. De hecho, tampoco te creas lo que lees aquí. La duda bien utilizada es un importante motor de crecimiento. UX es un fantástico oficio que necesita urgentemente de un mayor rigor estadístico para no caer en falacias como esta.Y hasta aquí la última edición de 2024.

En 2025 seguiremos, seguramente conectando en mayor medida la parte más técnica con la parte de UX: dos mundos que conectan ciencia y arte que deben ir más de la mano.

En 2025, trabajaremos para que eso sea así.

Felices fiestas.