#019 Un Test AB de Tres Millones de Dólares

No es clickbait.

En esta edición voy a presentar un caso que hemos vivido en LIN3S recientemente: un test AB que ha generado 3M$ perfectamente imputables a la P&L. No Bullsh*t. Te contaré cómo se nos ocurrió y el aprendizaje que extrajimos para que pueda inspirarte en tus próximos experimentos e ideas de producto.

Ahora sí, empieza la 19ª edición de Leanalytics:

Un test AB de 3 millones de dólares

Contexto del negocio

Imagina un negocio digital multipáis transaccional: un comercio electrónico que opera en varios mercados y que cuenta con el flujo tradicional y lineal de cualquier producto de este tipo.

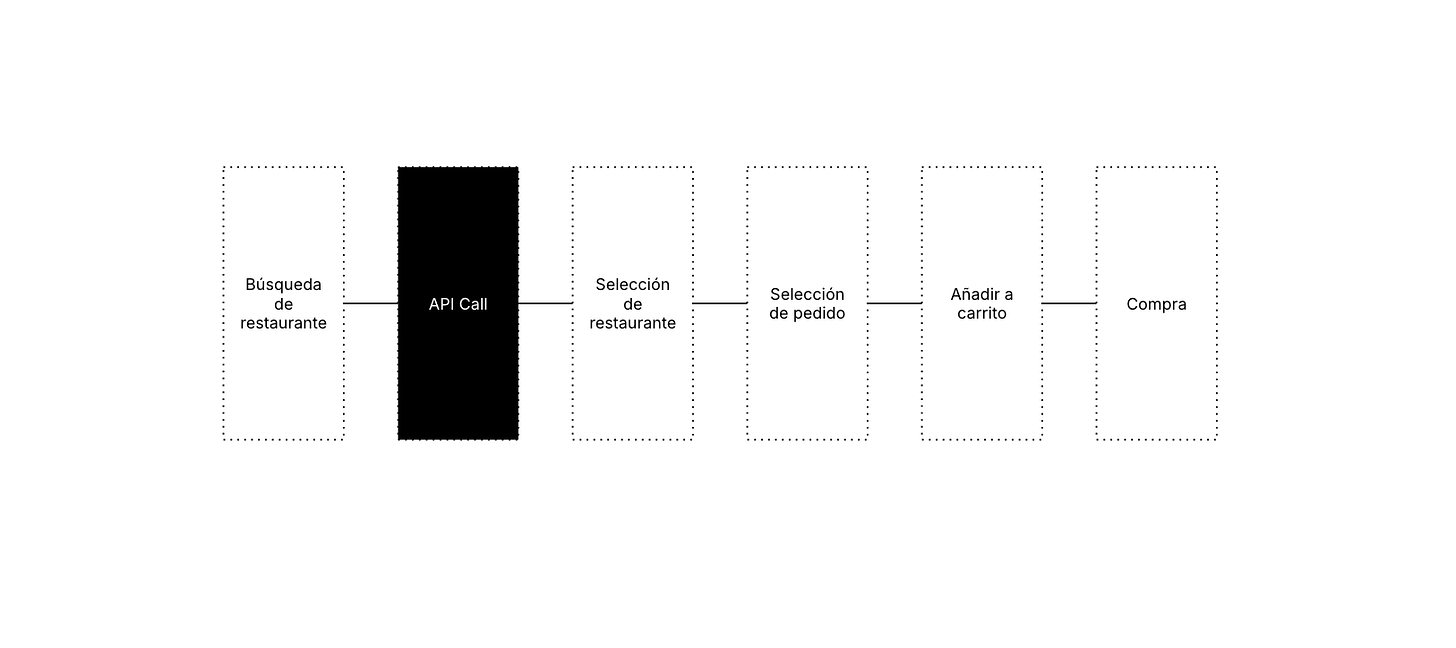

En la figura 19.1 ves la representación gráfica del flujo. En él podemos ver cómo el flujo va desde la búsqueda de un restaurante, pasa por la llamada a una API de un famoso callejero utilizado en este tipo de plataformas para seleccionar el restaurante y finaliza con la compra.

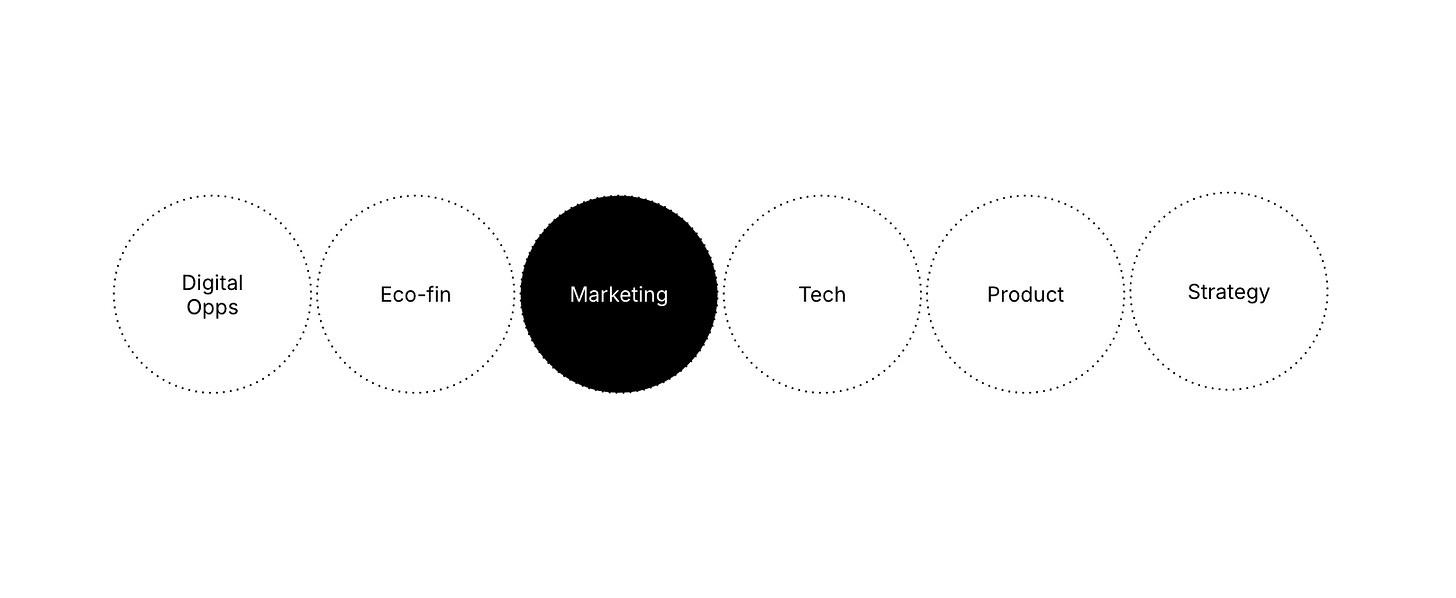

Fuimos contratados para aplicar CRO dentro del negocio digital y eso hacemos: trabajar para mejorar negocios digitales. La cuestión es que el marketing digital es solo una parte del negocio digital como muestro en la figura 19.2.

Ejecutar CRO únicamente pensando en marketing puede ser limitado. Encontrar oportunidades para influir en el comportamiento del usuario puede requerir un enfoque más holístico que incluya análisis de los procesos, costes, tecnología, dirección de producto, estructura de ingresos y costes, entre otros.

Gracias a este enfoque holístico, pudimos encontrar la oportunidad que a continuación voy a relatarte.

La oportunidad y la hipótesis

El equipo de CRO detectó un punto de mejora en el flujo de la figura 19.1. A raíz de una reunión con el equipo de producto se detectó una oportunidad que daría pie a uno de los tests más exitosos que he visto.

La API que se destaca en la primera figura, en esencia, se utilizaba para recomendar direcciones a partir de lo que el usuario escribía. Nada que no puedas imaginar y que no haya en cientos de productos digitales.

¿Qué podría salir mal?

A menudo, las API de este tipo tienen un coste a partir de un número determinado de usos. Sin embargo, recuerda que este negocio digital cuenta con millones de usuarios debido a que es multipaís y a que su uso puede tener cierto nivel de recurrencia mensual.

A continuación, el punto de mejora que detectó el equipo de CRO:

Oportunidad: la API genera un coste de 3 millones de euros cada año sumando todos los mercados y el flujo tiene serias mejoras de usabilidad que no aseguran que la API genere una buena experiencia para el usuario que influya en la venta. Dimos con algo muy interesante: un centro de costes que bien puede considerarse un centro de gasto si conseguimos generar el mismo volumen de ventas e ingresos con un flujo alternativo que no consuma esa API.

La hipótesis (H1) que planteamos no giraba tanto en torno a la idea de mejorar los flujos (ya que era bastante largo en total y sucedía mucho antes de los eventos de conversión clave como purchase). Más bien, nos centramos en una idea más realista: podemos crear un flujo visual que sin el uso de dicha API (que desde luego tenía su utilidad práctica) mantenga el mismo nivel de ingresos sin penalizar la experiencia.

Hipótesis alternativa (H1): Si establecemos un flujo alternativo que no consuma la API, entonces las ventas no se verán afectadas y la empresa ahorrará 3 millones de dólares.

Hipótesis nula (H0): Si establecemos un flujo alternativo que no consuma la API, entonces las ventas sí se verán afectadas y la empresa no ahorrará 3 millones de dólares.Pero no todo iba a ser tan fácil.

La solución y el test AB

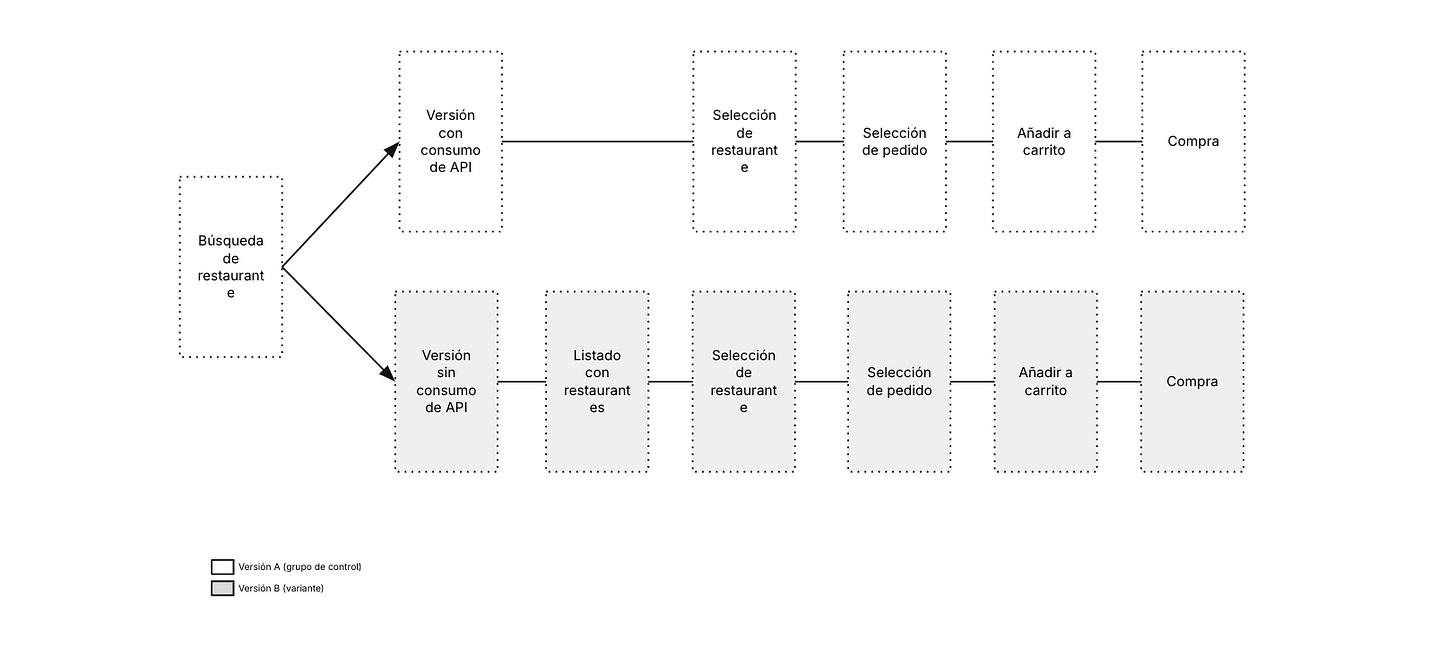

La API servía para algo. Crear un flujo alternativo que no realizara dicho consumo implicó diversas reuniones con producto, diseño, negocio y tecnología y al final había una cuestión de riesgo: había que añadir, sí o sí, una pantalla más.

Esa “pantalla más”, personalmente no me generaba ningún tipo de fricción. Es bien sabido que cada vez el número de pasos en muchos flujos importa menos. Sin embargo, había que convencer a mucha gente para este test y, desde luego, hubo nervios y tensión (lógico, por otro lado).

Se propuso hacer un test AB que, conceptualmente, era así (aunque la realidad suele ser más compleja): la versión en blanco es el grupo de control y en gris la variante propuesta con un paso más.

Métricas primarias, secundarias y terciarias: resultados

Para evaluar este test no bastaba con simplemente quedarse con la variante por no emitir ese gasto. Era importante evaluar un conjunto de métricas de manera cuidadosa. Como veréis, no se utilizaba OEC en dicho proyecto. Algunas de las métricas que protagonizaron el análisis fueron:

- Métricas primarias: selección de restaurantes, purchase, revenue, ARPU.

- Métricas secundarias: Visualización de producto, AOV, consumo de cupones, tipología de productos y cupones consumidos...

- Métricas terciarias: devoluciones.¿El resultado?

Aplicamos el proceso de diagnóstico de experimentos online que usamos en LIN3S y no se detectó ningún efecto significativo de manera práctica o estadística. De hecho, las pequeñas diferencias que podía haber iban más a favor de la variante que del grupo de control, aunque no eran tan grandes como para escudriñar que eran significativas.

No obstante, recordemos: no buscábamos que la variante fuera mejor. Buscábamos construir una versión suficientemente sólida que no afectara a las ventas ya que la variante ya contenía un ahorro de 3 millones de dólares por sí misma.

¿Durante cuántas semanas se dejó corriendo el experimento? La verdad es que esta es una pregunta típica. Aunque se recomendaba por nuestros análisis que estuviera durante 4 semanas, lo dejamos mucho más (6-8 semanas) para poder capturar un espectro más amplio y variable de usuarios por cuestiones del propio negocio (y, por qué no, justificar mejor la decisión).

Aprendizajes de este experimento

Este test hizo darme cuenta (o, más bien, recordó) muchas cosas que, a continuación, voy a enumerar:

La experimentación sirve como instrumento para gestionar el riesgo. Puedes imaginar que hubo dudas, preguntas y nervios fruto de la incerteza que esta idea (que no el test) generaba. El test no tenía la culpa: el test era el mecanismo para poner a prueba la idea de manera fidedigna y minimizando el riesgo.

CRO debe ir más allá de la optimización de pantalla aisladas. Abrazar un enfoque y metodología holísticas que vayan, incluso, más allá del marketing, es necesario para encontrar “las grandes oportunidades”.

Aunque hubiéramos detectado esta oportunidad al principio del proyecto, no hubiéramos podido trabajar sobre esta idea si no hubiéramos ganado previamente la confianza de los stakeholders clave. CRO es un ejercicio coral y las grandes misiones requieren de más colaboración si cabe. No esperes hacer esto el primer día en un proyecto nuevo.

Y hasta aquí esta edición. Espero que te haya gustado. Si es así, compártelo con tus amigos y amigas para dar a conocer que la experimentación va más allá del color de unos botones.

Que la fuerza te acompañe.